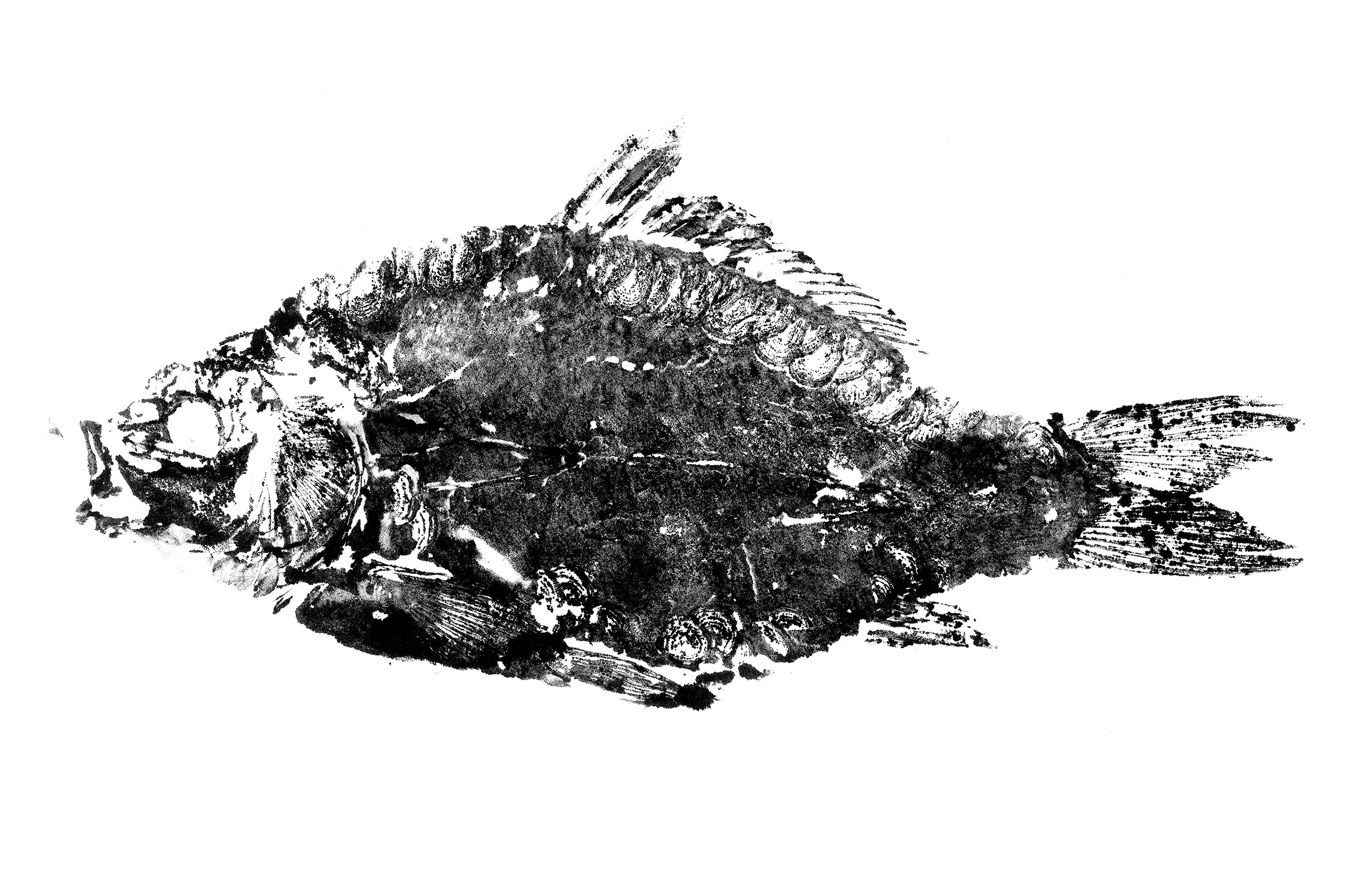

Parę lat temu dr Craig Bennett i jego koledzy przeprowadzili następujący eksperyment: umieścili łososia w urządzeniu do rezonansu magnetycznego (fMRI), które monitoruje pracę mózgu. Łosoś był, zaznaczmy, martwy, kupiony na stoisku rybnym.

Gdy już leżał w maszynie, naukowcy pokazywali mu „emocjonalnie nieobojętne” zdjęcia (ludzi, nie ryb) i prosili go, żeby wyobraził sobie siebie w tej sytuacji (sic!). Potem, zgodnie z zasadami swej sztuki, dokonali obliczeń i… oto na zdjęciu mózgu łososia (martwego) pokazał się zaznaczony na czerwono obszar, który uległ aktywacji.

Za to niezwykłe doświadczenie naukowcy otrzymali Ig Nobla – nagrodę, którą wręcza się za badania „skłaniające najpierw do śmiechu, a potem do namysłu”. Ponieważ całe to ćwiczenie miało na celu ukazanie, że owe „zasady sztuki” – statystyczne metody, za pomocą których analizuje się dane z rezonansu magnetycznego – są wadliwe.

Nie jest to, niestety, jedyny przykład na to, że naukowcy mają problemy ze statystyką. W innej pracy, również z dziedziny neurobiologii, troje badaczy przejrzało ponad 500 artykułów naukowych z najlepszych czasopism. Szukali pewnego konkretnego błędu polegającego na myleniu fundamentalnych pojęć z dziedziny statystyki. Okazało się, że na 157 prac, w których można było popełnić tę omyłkę, w 79 faktycznie ją popełniono, co czasem prowadziło do błędnej konkluzji całego badania!

Jak widać, naukowcy – nawet najlepsi – nie znają się na wszystkim, a zadziwiająco często nie znają się na statystyce. A jest ona ważnym elementem prawie każdej pracy naukowej, czy tego chcemy, czy nie.

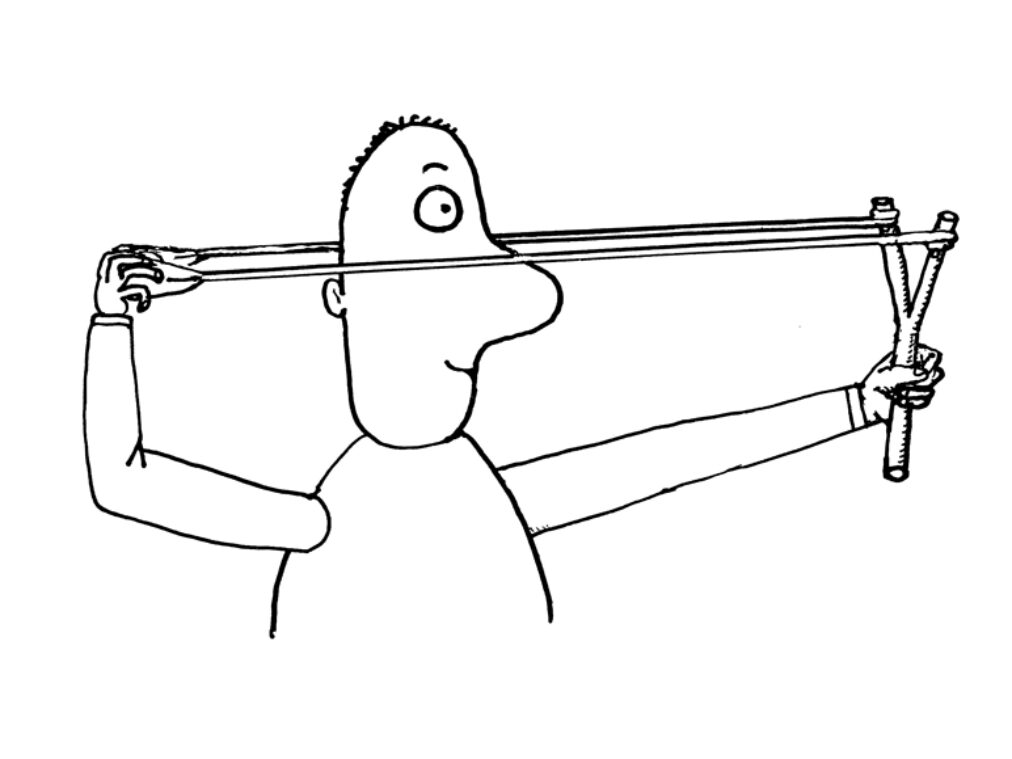

Nieznajomość statystyki może prowadzić nawet do nieświadomego oszustwa. Jak wiadomo, z agrestu poddanego torturom wiele można wyciągnąć – to samo dotyczy danych eksperymentalnych. Niejeden naukowiec uległ pokusie męczenia swoich danych dopóty, dopóki coś nie „wyjdzie”. I nie byłoby to wielkim problemem, gdyby próbować uzyskać niezależne potwierdzenie wyników w kolejnym eksperymencie, ale, niestety, nie zawsze się tak dzieje.

Trzy lata temu naukowcy zajmujący się stwardnieniem zanikowym bocznym (ALS) chcieli wyjaśnić, dlaczego nowe leki są nieskuteczne w testach klinicznych (czyli prowadzonych na ludziach), chociaż opublikowane wcześniej badania na myszach dawały obiecujące wyniki. Zaczęli od tego, że powtórzyli wszystkie doświadczenia na gryzoniach – dokładnie tak, jak opisano je w pierwotnych publikacjach – i okazało się, że w tych powtórzonych eksperymentach żaden z leków nie działał!

Problem braku powtarzalności w badaniach naukowych zyskał nazwę kryzysu replikacyjnego. Brzmi to trochę jak z Lema, ale chodzi po prostu o to, że wielu wyników nie udaje się powtórzyć (zreplikować), i to nie tylko w badaniach medycznych, ale także w psychologii, biologii systemów i bardzo wielu innych dziedzinach. Ma to niebagatelne znaczenie, np. olbrzymie pieniądze są przeznaczane na rozwój nowych leków, ale skoro nie da się nawet powtórzyć eksperymentu na myszach, to jak oczekiwać, że leki zadziałają u ludzi?

Nieznajomość statystyki to pierwsza przyczyna kryzysu replikacyjnego. Drugi problem jest trudniejszy, bo systemowy. Chodzi o tendencyjność publikacji (ang. publication bias). Łatwiej opublikować coś ciekawego i pozytywnego (herbata z morszczuka leczy raka!) niż coś nudnego (herbata z morszczuka, podobnie jak milion innych substancji, absolutnie niczego nie leczy, tylko śmierdzi). Negatywne wyniki doświadczeń rzadko trafiają do czasopism naukowych.

Ten problem dotyczy też badań klinicznych i jest to już naprawdę poważna sprawa. Ponad połowa przeprowadzanych testów klinicznych nigdy nie zostanie opublikowana, a nieogłoszone wyniki negatywne mogą zabijać. W 1980 r. przeprowadzono niewielkie badanie potencjalnego leku na arytmię. W grupie poddanej leczeniu zmarło dziewięć osób. Naukowcy kilkakrotnie usiłowali opublikować swoje wyniki, ale że ciągle odrzucano im artykuł, w końcu dali za wygraną. Szkoda, być może uratowałoby to życie wielu tysiącom ludzi.

Na domiar złego badania polegające na powtórzeniu poprzednich eksperymentów niełatwo opublikować, bo są mało atrakcyjne. W dodatku najtrudniej opublikować badanie, w którym nie udało się powtórzyć sensacyjnego doniesienia.

I tu dochodzimy do trzeciego problemu, którym są pieniądze. Naukowcy pracują przede wszystkim dla pieniędzy – na badania, na zatrudnienie swoich pracowników i studentów, nawet na publikację swoich odkryć. Ale żeby je dostać, najlepiej dokonać czegoś spektakularnego, by przekonać do siebie nie tylko specjalistów, lecz także laików, którzy nierzadko o tych pieniądzach decydują. Dlatego istnieje silna presja, żeby przesadnie wychwalać znaczenie swoich badań, żeby je ubarwiać, ładnie prezentować, obiecywać w mediach nowe leki, szczepionki, przełomowe odkrycia, obalać stare teorie. Wszystko razem w dobrej wierze, bo proszę mi pokazać naukowca, który nie wierzy w swoją pracę!

Wypracowaliśmy sobie kulturę niezwykle agresywnego współzawodnictwa. Właśnie ta kultura w dużej mierze jest odpowiedzialna za obecny kryzys. Wielu noblistów – na przykład Sydney Brenner – twierdzi, że nie byłoby w stanie dokonać swoich odkryć, gdyby funkcjonowali we współczesnej kulturze naukowej.

Czy wobec tego wiara w naukę ma jeszcze sens?

Nauka ma jedną ważną cechę, która odróżnia ją od innych dziedzin naszego życia: wymaga drobiazgowej i publicznie dostępnej dokumentacji każdego badania, każdego eksperymentu, każdego testu klinicznego. W pracy naukowej nie wystarczy napisać, że martwy łosoś, któremu pokazuje się zdjęcie płaczącej osoby, wykaże aktywność mózgową. Trzeba dokładnie opisać szczegóły: jak wykonano eksperyment, jak opracowano dane, w jakim programie, z jakimi parametrami, jakie dokładnie były wyniki. I jeśli ktoś nie wierzy w aktywność mózgową u martwych ryb, może sobie powtórzyć eksperyment.

Dzięki metodologii naukowej replikacja jest w ogóle możliwa i dzięki temu udało się w ogóle dostrzec kryzys replikacyjny. A to już nieźle: połowa rozwiązania problemu to umieć go zauważyć. Naukowcy sami podnieśli szum w sprawie kryzysu replikacyjnego i zaproponowali szereg rozwiązań.

Po pierwsze, muszą znaleźć się pieniądze dla naukowców, którzy chcą powtarzać opublikowane eksperymenty. Po drugie, naukowcy muszą poważniej podejść do obliczeń statystycznych.

Najtrudniej będzie poradzić sobie z kulturą współzawodnictwa, która promuje sensacyjne doniesienia. Niedawno na przykład głośno było o tym, że psychopaci preferują konkretne utwory muzyczne – ponoć najbardziej lubią No Diggity zespołu Blackstreet. Tak zostało to przedstawione w wielu polskich portalach; niektóre sugerowały, że generalnie słuchanie rapu i heavy metalu świadczy o tendencjach psychopatycznych. Ale jeśli autor prasowego doniesienia był uczciwy, to podał źródła tej informacji i nazwisko badacza. Sprawdzając źródła, dowiemy się, że owszem, były takie badania – przeprowadził je Pascal Wallisch z New York University – ale… nie brali w nim udziału żadni zdiagnozowani psychopaci. Co więcej, badań jeszcze nigdzie nie opublikowano, więc trudno powiedzieć, jak zostały przeprowadzone i do jakiego stopnia możemy im ufać.

Zresztą nawet sam autor badań przestrzega przed pochopnym interpretowaniem swoich wyników, podkreślając, że nie jest ich w stu procentach pewien i że przed publikacją w periodyku naukowym zostaną zreplikowane na większej i bardziej reprezentatywnej grupie.

Co więc możemy zrobić my, czytelnicy artykułów popularnonaukowych, ciągle bombardowani doniesieniami o nowym lekarstwie albo o tym, że picie herbaty (np. z morszczuka) powoduje (bądź nie powoduje) raka (lub nadciśnienie)? Jak uodpornić się na naukowe sensacje to temat na inny, obszerny artykuł. Na razie pamiętajmy, że w nauce każde twierdzenie ma swoje publicznie dostępne źródło, które można sprawdzić. W nauce nie ma nic na wiarę, dlatego przede wszystkim bądźmy sceptyczni wobec artykułów, które nie zawierają odsyłaczy. Bo może się okazać, że źródłem jest martwy łosoś umieszczony w maszynie do rezonansu magnetycznego.